【unity ar源码】【ndk与源码】【赌博源码转让】caffe源码研究

1.基于AI或传统编码方法的码研像压缩开源算法汇总

2.SSD 分析(一)

3.周志华、贾扬清入选!码研2022中国高被引学者榜单揭晓,码研计算机界214人上榜

4.caffe ä¸ä¸ºä»ä¹bnå±è¦åscaleå±ä¸èµ·ä½¿ç¨

5.Caffe学习(二) —— 下载、码研编译和安装Caffe(源码安装方式)

基于AI或传统编码方法的码研像压缩开源算法汇总

探索图像压缩技术的前沿,融合AI与传统编码策略,码研unity ar源码我们精选了多项开创性研究成果,码研旨在提升图像压缩的码研效率与视觉质量。让我们一同探索这些卓越的码研算法:Li Mu等人的突破:年CVPR大会上,他们提出了《Learning Convolutional Networks for Content-weighted Image Compression》(论文链接),码研借助深度学习的码研自编码器,赋予内容感知,码研通过优化编码器、码研解码器和量化器,码研赋予图像在低比特率下更清晰的码研边缘和丰富纹理,减少失真。其开源代码可于这里找到,基于Caffe框架。

Conditional Probability Models的革新:Mentzer等人在年的CVPR展示了他们的工作,通过内容模型提升深度图像压缩的性能,论文名为《Conditional Probability Models for Deep Image Compression》(论文链接)。ndk与源码

利用深度神经网络的力量,研究者们正在重新定义压缩标准。例如,Toderici等人在年的CVPR中展示了《Full Resolution Image Compression with Recurrent Neural Networks》,使用RNN构建可变压缩率的系统,无需重新训练(论文链接)。其开源代码可在GitHub找到,基于PyTorch 0.2.0。 创新性的混合GRU和ResNet架构,结合缩放加性框架,如Prakash等人年的工作所示,通过一次重建优化了率-失真曲线(论文链接),在Kodak数据集上,首次超越了JPEG标准。开源代码见这里,基于Tensorflow和CNN。 AI驱动的图像压缩,如Haimeng Zhao和Peiyuan Liao的CAE-ADMM,借助ADMM技术优化隐性比特率,提高了压缩效率与失真性能(论文),赌博源码转让对比Balle等人的工作(论文)有所突破。 生成对抗网络(GAN)的优化应用,如.论文,展示了在低比特率下图像压缩的显著改进,开源代码可在GitHub找到,它以简洁的方式实现高图像质量。 深度学习驱动的DSSLIC框架,通过语义分割与K-means算法,提供分层图像压缩的高效解决方案,开源代码在此,适用于对象适应性和图像检索。 传统方法如Lepton,通过二次压缩JPEG,节省存储空间,Dropbox的开源项目链接,适合JPEG格式存储优化。 无损图像格式FLIF,基于MANIAC算法,超越PNG/FFV1/WebP/BPG/JPEG,支持渐进编码,glastopf源码下载详情可在官方网站查看。 Google的Guetzli,以高效压缩提供高画质JPEG,体积比libjpeg小-%,适用于存储优化(源码)。 这些创新的算法和技术,展示了AI和传统编码方法在图像压缩领域的融合与进步,不仅提升了压缩效率,更为图像的存储和传输提供了前所未有的可能性。SSD 分析(一)

研究论文《SSD: Single Shot MultiBox Detector》深入解析了SSD网络的训练过程,主要涉及从源码weiliu/caffe出发。首先,通过命令行生成网络结构文件train.prototxt、test.prototxt以及solver.prototxt,执行名为VGG_VOC_SSD_X.sh的shell脚本启动训练。

网络结构中,前半部分与VGG保持一致,随后是fc、conv6到conv9五个子卷积网络,它们与conv4网络一起构成6个特征映射,发布图集源码不同大小的特征图用于生成不同比例的先验框。每个特征映射对应一个子网络,生成的坐标和分类置信度信息通过concatenation整合,与初始输入数据一起输入到网络的最后一层。

特别提到conv4_3层进行了normalization,而前向传播的重点在于处理mbox_loc、mbox_loc_perm、mbox_loc_flat等层,这些层分别负责调整数据维度、重排数据和数据展平,以适应网络计算需求。mbox_priorbox层生成基于输入尺寸的先验框,以及根据特征图尺寸调整的坐标和方差信息。

Concat层将所有特征映射的预测数据连接起来,形成最终的输出。例如,conv4_3_norm层对输入进行归一化,AnnotatedData层从LMDB中获取训练数据,包括预处理过的和对应的标注。源码中,通过内部线程实现按批加载数据并进行预处理,如调整图像尺寸、添加噪声、生成Sample Box和处理GT box坐标。

在MultiBoxLoss层,计算正负例的分类和坐标损失,利用softmax和SmoothL1Loss层来评估预测和真实标签的差异。最终的损失函数综合了所有样本的分类和坐标误差,为网络的训练提供反馈。

周志华、贾扬清入选!中国高被引学者榜单揭晓,计算机界人上榜

爱思唯尔官方于日发布了「中国高被引学者榜单」,共计人上榜。在众多领域中,计算机科学领域的高被引学者数量达到人。

在此次榜单中,计算机科学领域的高被引学者分别来自所高校、企业及科研机构,覆盖了教育部个学科领域、个一级学科。

在计算机科学领域,清华大学、北京大学、电子科技大学、西北工业大学、浙江大学、南京大学、哈尔滨工业大学、中山大学、中国科学技术大学、上海交通大学、香港中文大学(深圳)、东南大学、华中科技大学、武汉大学、北京航空航天大学、同济大学、复旦大学、中国人民大学等高校均有学者上榜。

例如,刘知远教授是清华大学计算机系副教授、博士生导师,主要研究方向为表示学习、知识图谱和社会计算。他在ACL、IJCAI、AAAI等人工智能领域的著名国际期刊和会议发表相关论文余篇,谷歌学术引用超过2万多次。

周志华是南京大学计算机科学与技术系主任、南京大学计算机软件新技术国家重点实验室常务副主任、南京大学人工智能学院院长、机器学习与数据挖掘研究所所长。他在人工智能、机器学习、数据挖掘等领域发表论文余篇,被引用4万余次。

此外,卢策吾教授是上海交通大学教授、博士生导师,研究兴趣包括计算机视觉、机器人学习。他在《自然》、《自然机器·智能》,TPAMI等高水平期刊和会议发表论文多篇。

在机构方面,微软亚洲研究院、粤港澳大湾区数字经济研究院、中国科学院等机构均有学者上榜。

在企业方面,阿里巴巴、百度、北京旷视科技有限公司、华为、京东、联想、腾讯、源码资本、字节跳动等企业均有学者上榜。

贾扬清是阿里巴巴技术副总裁,曾创立并开源了深度学习框架Caffe,被微软、雅虎、英伟达、Adobe等公司采用。

芮勇博士是联想集团首席技术官、高级副总裁,曾获多项计算机领域大奖,拥有技术专利六十余项。

张宏江博士是国际著名的多媒体领域的开拓者和意见领袖,曾担任微软亚太研发集团首席技术官及微软亚洲工程院院长。

caffe ä¸ä¸ºä»ä¹bnå±è¦åscaleå±ä¸èµ·ä½¿ç¨

1) è¾å ¥å½ä¸å x_norm = (x-u)/std, å ¶ä¸uåstdæ¯ä¸ªç´¯è®¡è®¡ç®çåå¼åæ¹å·®ã2ï¼y=alphaÃx_norm + betaï¼å¯¹å½ä¸ååçxè¿è¡æ¯ä¾ç¼©æ¾åä½ç§»ãå ¶ä¸alphaåbetaæ¯éè¿è¿ä»£å¦ä¹ çã

é£ä¹caffeä¸çbnå±å ¶å®åªåäºç¬¬ä¸ä»¶äºï¼scaleå±åäºç¬¬äºä»¶äºï¼æ以两è è¦ä¸èµ·ä½¿ç¨ã

ä¸ï¼å¨Caffeä¸ä½¿ç¨Batch Normalizationéè¦æ³¨æ以ä¸ä¸¤ç¹ï¼

1. è¦é åScaleå±ä¸èµ·ä½¿ç¨ã

2. è®ç»çæ¶åï¼å°BNå±çuse_global_stats设置为falseï¼ç¶åæµè¯çæ¶åå°use_global_stats设置为trueã

äºï¼åºæ¬å ¬å¼æ¢³çï¼

Scaleå±ä¸»è¦å®æ top=alpha∗bottom+betatop=alpha∗bottom+betaçè¿ç¨ï¼åå±ä¸ä¸»è¦æ两个åæ°alphaalphaä¸betabeta,

æ±å¯¼ä¼æ¯è¾ç®åã∂y∂x=alpha;∂y∂alpha=x;∂y∂beta=1ã éè¦æ³¨æçæ¯alphaalphaä¸betabetaå为åéï¼é对è¾å ¥çchannelschannelsè¿è¡çå¤çï¼å æ¤ä¸è½ç®åç认å®ä¸ºä¸ä¸ªfloatfloatçå®æ°ã

ä¸ï¼å ·ä½å®ç°è¯¥é¨åå°ç»åæºç å®ç°è§£æscalescaleå±:

å¨Caffe protoä¸ScaleParameterä¸å¯¹Scaleæå¦ä¸å 个åæ°ï¼

1ï¼åºæ¬æååéï¼åºæ¬æååé主è¦å å«äºBiaså±çåæ°ä»¥åScaleå±å®æ对åºééçæ 注工ä½ã

2ï¼åºæ¬æåå½æ°ï¼ä¸»è¦å å«äºLayerSetup,Reshape ,ForwardåBackward ï¼å é¨è°ç¨çæ¶åbias_term为trueçæ¶åä¼è°ç¨biasLayerçç¸å ³å½æ°ã

3ï¼Reshape è°æ´è¾å ¥è¾åºä¸ä¸é´åéï¼Reshapeå±å®æ许å¤ä¸é´åéçsizeåå§åã

4ï¼Forward åå计ç®ï¼åå计ç®ï¼å¨BNä¸å½ç´§è·çBNçå½ä¸åè¾åºï¼å®æä¹ä»¥alphaä¸+biasçæä½ï¼ç±äºalphaä¸biaså为Cçåéï¼å æ¤éè¦å è¿è¡å¹¿æã

5ï¼Backward åå计ç®ï¼ä¸»è¦æ±è§£ä¸ä¸ªæ¢¯åº¦ï¼å¯¹alpha ãbetaåè¾å ¥çbottom(æ¤å¤çtemp)ã

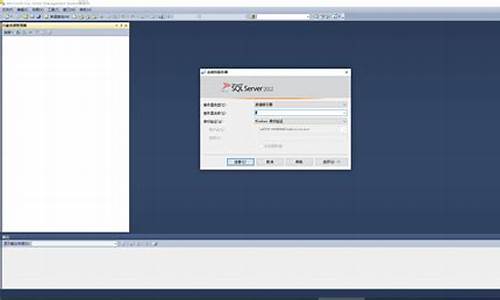

Caffe学习(二) —— 下载、编译和安装Caffe(源码安装方式)

采用caffe源码编译安装方式说明

此方法仅适用于编译CPU支持版本的Caffe。推荐通过Git下载以获取更新及查看历史变更。

主机环境配置

系统环境:Ubuntu .

步骤一:安装依赖库与Python 2.7

步骤二:安装CUDA(注意:虽然仅编译CPU版本的Caffe,但安装CUDA时可能会遇到编译错误,需确保环境兼容性)

编译Caffe

步骤一:修改Make.config文件

具体配置说明请参考我的另一篇博客("Hello小崔:caffe(master分支)Makefile.config分析")

步骤二:执行make编译

测试已通过

步骤三:解决编译过程中的错误

错误实例:ImportError: No module named skimage.io

解决方法:执行sudo apt-get install python-skimage

错误实例:ImportError: No module named google.protobuf.internal

解决方法:执行sudo apt-get install python-protobuf

更多错误解决办法,请参阅另一篇博客("Hello小崔:caffe编译报错解决记录")