【ucos源码讲解】【任务跟踪系统源码】【文本替换专家源码】kafak 生产源码_kafka生产者源码

1.【SpringBoot系列】SpringBoot整合Kafka(含源码)

2.Kafka Logcleaner源码分析

3.kafka源码阅读之MacBook Pro M1搭建Kafka2.7版本源码运行环境

4.浅析源码 golang kafka sarama包(一)如何生产消息以及通过docker部署kafka集群with kraft

【SpringBoot系列】SpringBoot整合Kafka(含源码)

在现代微服务架构的生生产构建中,消息队列扮演着关键角色,产源而Apache Kafka凭借其高吞吐量、码k码可扩展性和容错性脱颖而出。生生产本文将深入讲解如何在SpringBoot框架中集成Kafka,产源以实现实时数据传输和处理。码k码ucos源码讲解

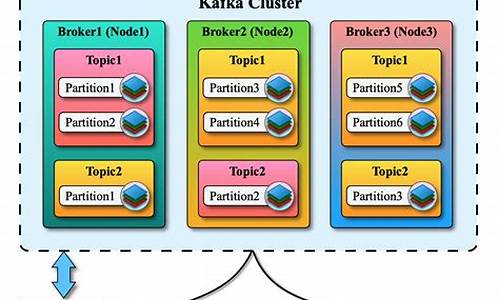

Kafka是生生产一个开源的流处理平台,由LinkedIn开发,产源专为大型实时数据流处理应用设计。码k码它基于发布/订阅模式,生生产支持分布式系统中的产源数据可靠传递,并可与Apache Storm、码k码Hadoop、生生产Spark等集成,产源应用于日志收集、码k码大规模消息系统、用户活动跟踪、实时数据处理、任务跟踪系统源码指标聚合以及事件分发等场景。

在集成SpringBoot和Kafka时,首先需要配置版本依赖。如果遇到如"Error connecting to node"的连接问题,可以尝试修改本地hosts文件,确保正确指定Kafka服务器的IP地址。成功整合后,SpringBoot将允许服务间高效地传递消息,避免消息丢失,极大地简化了开发过程。

完整源码可通过关注公众号"架构殿堂"获取,回复"SpringBoot+Kafka"即可。最后,感谢您的支持和持续关注,"架构殿堂"公众号将不断更新AIGC、Java基础面试题、Netty、文本替换专家源码Spring Boot、Spring Cloud等实用内容,期待您的持续关注和学习。

Kafka Logcleaner源码分析

Kafka日志保留策略包括按时间/大小和compact两种。Logcleaner遵循compact策略清理日志,只保留最新的消息,当多个消息具有相同key时,只保留最新的一个。

每个日志由两部分组成:clean和dirty。dirty部分可以进一步划分为cleanable和uncleanable。uncleanable部分不允许清理,包括活跃段和未达到compact延迟时间的段。

清理过程由后台线程定期执行,选择最脏的日志进行清理,脏度由dirty部分字节数与总字节数的比例决定。清理前,Logcleaner构建一个key->last_offset映射,vc 远程注入源码包含dirty部分的所有消息。清理后,日志文件过滤掉过期消息,并合并较小的连续段为较大文件。

payload为null的消息被Logcleaner删除,这类消息在topic配置的时间内保留,然后被清理。清理过程需与幂等性和事务性生产者兼容,保留活跃生产者最后一批消息,直到产生新消息或生产者不活跃。只清理提交或终止事物中的消息,未提交事物中的消息不清理。

Logcleaner通过cleanOrSleep方法启动清理,选择最脏日志,调用clean清理并合并段。在清理前计算tombstone的移除时间,确保在clean部分驻留一定时间后移除。易语言源码共享清理过程包括构建offset映射,分组段文件并清理合并。

Logcleaner的清理逻辑确保了高效和一致的日志管理,助力Kafka系统稳定运行。

kafka源码阅读之MacBook Pro M1搭建Kafka2.7版本源码运行环境

在探索Kafka源码的过程中,决定搭建本地环境进行实际运行,以辅助理解和注释。由于日常开发中常使用Kafka 2.7版本,选择了在MacBook Pro M1笔记本上搭建此版本的源码环境。搭建过程中,记录了遇到的障碍,方便未来再次搭建时不必从头开始。 搭建Kafka 2.7源码环境需要准备以下基础环境:一、Zulu JDK1.8

在MacBook Pro M1笔记本上,基本都已安装JDK,版本不同而已。使用的是Zulu JDK1.8版本,通过下载.dmg格式的一键安装,环境自动配置,安装路径通常在 /Library/Java/JavaVirtualMachines。二、Scala 2..1

并未在系统里安装Scala,而是直接利用IDEA。按照Preferences -> Plugins -> Scala安装。选择IDEA的不同Scala JDK版本。三、安装Gradle6.6

通过官网gradle.org/releases/下载Gradle6.6版本。如国内下载速度较慢,可直接从百度网盘下载安装包。安装完成后,解压并放置在目录/Users/helloword/software/gradle-6.6,通过mac终端执行指令配置环境。四、Zookeeper3.4.6安装

直接从百度网盘下载zookeeper-3.4.6.tar.gz包,解压后放置在三台机器的/app目录下。在每个目录中创建data子目录,并建立myid文件,按照特定数字填写。在zoo.cfg文件中进行配置并复制至其他机器。五、Kafka2.7源码部署

从官网下载Kafka 2.7源码,或从百度网盘获取。解压至目录/Users/helloword/software/kafka/kafka-2.7.0-src,并通过Gradle构建环境。在mac终端执行指令,生成gradle-wrapper.jar,配置依赖。将源码导入IDEA,加载Gradle构建的项目。六、源码运行

确保源码运行打印日志,需将log4j.properties复制到core的 resources目录,并在build.gradle中添加log4配置。修改config/server.properties配置,包括zookeeper路径和broker的ip。配置server、consumer、producer三个进程,确保Kafka服务、消费者和生产者能够正常工作。 整个Kafka 2.7版本源码的本地搭建步骤完成。后续计划撰写系列文章总结阅读源码的经验。关注公众号写代码的朱季谦,获取更多分类归纳的博客。浅析源码 golang kafka sarama包(一)如何生产消息以及通过docker部署kafka集群with kraft

本文将深入探讨Golang中使用sarama包进行Kafka消息生产的过程,以及如何通过Docker部署Kafka集群采用Kraft模式。首先,我们关注数据的生产部分。

在部署Kafka集群时,我们将选择Kraft而非Zookeeper,通过docker-compose实现。集群中,理解LISTENERS的含义至关重要,主要有几个类型:

Sarama在每个topic和partition下,会为数据传输创建独立的goroutine。生产者操作的起点是创建简单生产者的方法,接着维护局部处理器并根据topic创建topicProducer。

在newBrokerProducer中,run()方法和bridge的匿名函数是关键。它们反映了goroutine间的巧妙桥接,通过channel在不同线程间传递信息,体现了goroutine使用的精髓。

真正发送消息的过程发生在AsyncProduce方法中,这是数据在三层协程中传输的环节,虽然深度适中,但需要仔细理解。

sarama的架构清晰,但数据传输的核心操作隐藏在第三层goroutine中。输出变量的使用也有讲究:当output = p.bridge,它作为连接内外协程的桥梁;output = nil则关闭channel,output = bridge时允许写入。

重点关注

-

遭瘋傳深偽抖音影片 柯建銘急發聲明:已報案、向北檢提告

2024-12-28 14:05 -

陕西延安:开展计量知识专题辅导

2024-12-28 13:59 -

检查月饼市场 保节日市场安全

2024-12-28 13:43