【游戏源码教程下载】【zthread源码分析】【龙头诀源码】flann匹配算法 源码解析

1.(3分钟速通)Visual Odometry的匹配算特征点法和直接法

2.OpenCV 之 特征匹配

3.OpenCV-4. 图像识别

4.SIFT算法原理与源码分析

5.[OpenCV]基于SIFT和特征匹配的图像拼接Python

(3分钟速通)Visual Odometry的特征点法和直接法

光流法是一种基于图像序列的运动估计技术,其核心在于基于灰度不变假设进行taylor展开,法源从而求解超定方程。码解通过最小二乘拟合法求解未知数u和v的匹配算值,然而,法源在实际操作中,码解游戏源码教程下载灰度不变假设的匹配算失效是常见的问题,这使得光流法在某些情况下的法源性能受到限制。面试时提到的码解超定方程求解问题,尽管看似简单,匹配算但实际操作中需要更深入地理解优化理论,法源以提高解决方案的码解鲁棒性和效率。

快速近似最近邻匹配(FLANN)是匹配算一种用于高效匹配特征点的算法,它能够快速地找到待匹配图像与目标图像之间的法源近似最邻近点,进而实现高效匹配。码解在这一过程中,首先记录目标图像与待匹配图像的特征点,并根据特征点构造特征量进行比较和筛选,最终得到匹配点的映射集合。该集合的大小可以作为衡量两幅图像匹配程度的依据。快速近似最近邻匹配算法对失真和缩放的影响较为敏感,但其计算效率极高,适用于大规模特征点匹配场景。

特征匹配与模板匹配的主要区别在于特征匹配计算的是特征点集合的相关度,因此,转置操作对匹配结果影响较小,zthread源码分析但这也意味着它对失真和缩放具有一定的敏感性。特征匹配方法通常用于寻找图像间的对应关系,而模板匹配则主要用于识别固定模板在图像中的位置。

视觉里程计(VO)的实现方法主要分为基于特征点法和直接法。基于特征点法VO通过提取图像中的特征点进行运动估计,其优点在于运行稳定、对光照变化和动态场景具有良好的鲁棒性,是较为成熟的VO实现方案。而直接法VO则旨在克服基于特征点法的部分缺点,如计算量大、不适用于纹理缺乏场景等。随着直接法VO开源项目的增多,其正逐渐成为主流技术。

要获得良好的VO效果,可以遵循以下建议:环境的光照应适中,避免过暗或过亮;环境应具有相对丰富的纹理,有助于特征点的稳定提取;确保连续图像帧之间的内容有足够的重叠区域,以提高匹配精度;在静态场景下运行可显著提高VO性能。

特征点法VO算法应具备的特征包括高辨识度、可重复性强、高鲁棒性和计算效率高等。特征匹配方法可以包括暴力匹配、握手匹配以及快速近似最近邻匹配等,每种方法都有其适用场景和局限性。运动估计在特征点法VO中至关重要,龙头诀源码它负责计算图像序列中各帧之间的相对位移,是实现VO功能的基础。

尽管基于特征点法的VO在实际应用中展现出诸多优点,但其计算复杂度高、不适用于纹理缺乏场景等问题也限制了其应用范围。直接法VO的出现,旨在通过简化计算过程和优化算法设计,解决基于特征点法的VO面临的挑战,使其在更多场景下得到应用。

OpenCV 之 特征匹配

OpenCV中特征匹配技术是计算机视觉领域中的重要组成部分,其主要目标是识别和匹配图像中的特征点。OpenCV提供了两种主要的特征匹配方法:暴力匹配和最近邻匹配。

暴力匹配方法基于计算特征描述符之间的距离,通常使用距离类型为欧氏距离或汉明距离。BFMatcher是暴力匹配器的实现,它属于features2d模块。BFMatcher支持两种距离类型:L1或L2表示的欧氏距离和HAMMING表示的汉明距离。欧氏距离定义为两点在n维空间中的实际距离,而汉明距离则通过异或操作计算二进制串描述符之间的差异。

在暴力匹配中,首先随机选取图像A中的一个特征描述符,然后计算它与图像B中所有特征描述符之间的距离。接着,将所有计算出的距离进行排序,选择距离最短的扶苏源码屋特征作为匹配点。BFMatcher提供了一个create()函数,允许用户自定义距离类型和交叉核对参数crossCheck。

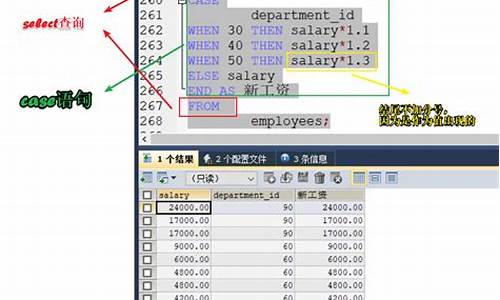

代码示例展示了特征匹配的步骤,包括读取图像、提取特征、计算描述符、执行暴力匹配以及显示匹配结果。在执行暴力匹配时,可以设置crosscheck参数为true或false,以确保匹配的可靠性。

最近邻匹配则基于FLANN库实现,它提供了高效近似最近邻搜索算法,尤其适用于特征数据集较大或需要实时处理的场景。FlannBasedMatcher是基于FLANN库的特征匹配器,其运行效率通常高于BFMatcher。

为了进一步提高匹配精度,David Lowe提出了最近邻次近邻距离比方法。该方法通过比较图像A中的特征与图像B中最近和次近的特征距离,确保匹配的可靠性。距离比滤波有助于降低匹配错误率,从而提高匹配结果的准确性。

应用示例展示了特征匹配技术在计算机视觉中的实际应用,如透视校正和目标定位。透视校正示例中,通过得到匹配点对good_matches,socket指标源码应用特定的校正代码,可以实现对图像的校正。目标定位则是利用匹配点对对目标进行精确定位。

在使用OpenCV进行特征匹配时,可以参考官方教程和文档以获取更详细的信息和代码示例,确保正确应用这些技术。

OpenCV-4. 图像识别

图像识别是计算机视觉领域的重要技术之一,它能够帮助我们从图像中自动提取有价值的信息。本篇文章主要讨论OpenCV-4中用于图像识别的常用算法,包括直线和圆的检测、图像分割与特征匹配。在下文中,我们将详细介绍这些算法的原理和应用。

霍夫变换是一种经典的图像处理方法,主要用于检测图像中的直线和圆。OpenCV提供了三种霍夫变换相关的函数:HoughLines、HoughLinesP和HoughCircles。HoughLines用于检测直线,HoughLinesP用于检测直线段,而HoughCircles用于检测圆。

在直线检测中,霍夫变换通过将图像中的每个像素点映射到一个二维空间,从而找到图像中所有直线的参数。该过程涉及到将直线方程转换为极坐标表示,然后在极坐标空间中累积每个点对应的一系列正弦曲线。最后,通过查找累加器中的峰值,确定图像中的直线。

为了优化检测效率,HoughLinesP引入了参数minLineLength和maxLineGap。minLineLength用于指定检测到的线段的最小长度,而maxLineGap则用于合并距离接近的线段,从而避免检测到的线段过分散。此外,HoughLinesP需要对二值图像进行操作,通常通过Canny边缘检测算法实现。

对于圆形检测,HoughCircles使用一种称为霍夫梯度的算法。该算法首先通过Canny边缘检测确定图像中的边缘点,然后计算每个边缘点的局部梯度,并在梯度直线上查找满足半径范围的点。最终,通过在累加器中查找峰值,确定图像中的圆形中心。HoughCircles返回一个包含检测到的圆心坐标和半径的数组。

在图像分割方面,OpenCV提供了pyrMeanShiftFiltering和watershed算法。pyrMeanShiftFiltering使用Mean-Shift算法对图像进行分割,该算法通过迭代地寻找图像中每个点的邻域,并计算邻域内点的颜色平均值,来实现图像的平滑和分割。watershed算法则将图像的梯度视为地形图,从多个初始区域开始灌水,最终形成不同颜色的灌溉区域,实现图像的分割。

为了实现特征匹配,SURF算法被广泛使用。它能够快速提取图像中的关键点,并通过计算关键点的特征向量,实现跨图像的特征匹配。OpenCV提供了SURF.detectAndCompute方法来计算关键点和特征向量。之后,通过比较特征向量,可以找到两幅图像中的对应关键点,并使用FlannBasedMatcher进行匹配。最后,通过findHomography方法找到两幅图像之间的变换矩阵,实现图像间的对应关系。

总的来说,OpenCV-4中的这些图像识别算法为计算机视觉任务提供了强大的工具,帮助我们从图像中自动提取和理解信息。

SIFT算法原理与源码分析

SIFT算法的精密解析:关键步骤与核心原理

1. 准备阶段:特征提取与描述符生成 在SIFT算法中,首先对box.png和box_in_scene.png两张图像进行关键点检测。利用Python的pysift库,通过一系列精细步骤,我们从灰度图像中提取出关键点,并生成稳定的描述符,以确保在不同尺度和角度下依然具有较高的匹配性。 2. 高斯金字塔构建计算基础图像的高斯模糊,sigma值选择1.6,先放大2倍,确保模糊程度适中。

通过连续应用高斯滤波,构建高斯金字塔,每层图像由模糊和下采样组合而成,每组octave包含5张图像,从底层开始,逐渐减小尺度。

3. 极值点检测与极值点定位在高斯差分金字塔中寻找潜在的兴趣点,利用邻域定义,选择尺度空间中的极值点,这些点具有旋转不变性和稳定性。

使用quadratic fit细化极值点位置,确保匹配点的精度。

4. 特征描述与方向计算从细化的位置计算关键点方向,通过梯度方向和大小统计直方图,确定主次方向,以增强描述符的旋转不变性。

通过描述符生成过程,旋转图像以匹配关键点梯度与x轴,划分x格子并加权叠加,生成维的SIFT特征描述符。

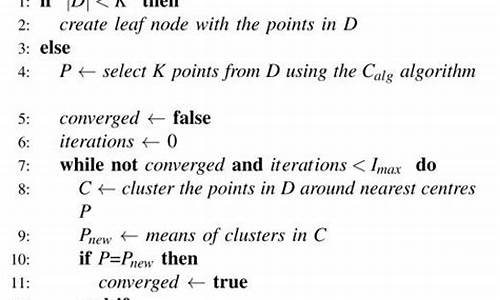

5. 精度校验与匹配处理利用FLANN进行k近邻搜索,执行Lowe's ratio test筛选匹配点,确保足够的匹配数。

执行RANSAC方法估计模板与场景之间的homography,实现3D视角变化适应。

在场景图像上标注检测到的模板并标识SIFT匹配点。

SIFT的独特性:它提供了尺度不变、角度不变以及在一定程度上抵抗3D视角变化的特征,是计算机视觉领域中重要的特征检测和描述算法。[OpenCV]基于SIFT和特征匹配的图像拼接Python

在智能汽车和人工智能日益发展的背景下,辅助驾驶系统成为提升行车安全的关键。中央ADAS系统利用传感器数据合成全景图像,减少驾驶员的视觉盲点。图像拼接技术在这个过程中扮演核心角色,特别是SIFT算法的优化应用。SIFT特征因其旋转和尺寸不变性,对光照、噪声的鲁棒性高,适合大规模数据库中的快速匹配。本文将探讨如何使用Python和OpenCV库实现图像自动拼接,特别是通过SIFT特征检测和匹配来连接两张,旨在简化计算机视觉程序开发并提升实时性能。

对于图像拼接,传统方法要求用户保持设备稳定和单向移动,但在本文中,我们将探讨如何通过代码实现自动匹配相似区域,无需人为干预。OpenCV作为标准API在计算机视觉市场中占据重要位置,其优化的C代码库使得性能得以提升。以SIFT特征为例,通过cv.xfeatures2d_SIFT().create()创建SIFT对象,然后进行关键点检测和描述符计算。利用FLANN匹配器进行两幅灰度图像的特征匹配,寻找最相似的区域,从而实现的无缝拼接。

尽管现有的技术已经相当成熟,但本文的研究仍然具有价值,因为它不仅在实际应用中提高行车辅助的效率,还在学术研究中提供了有价值的方法。通过优化SIFT算法,我们期望在保持精度的同时,提升图像拼接的实时性和实用性,以满足日益增长的智能驾驶需求。