【现成的系统源码】【全息操盘指标源码】【黑马影视app源码】存储源码分析_存储源码分析方法

1.开源即时通讯GGTalk源码剖析之:客户端全局缓存及本地存储

2.Redis源码解析:一条Redis命令是存储存储如何执行的?

3.链桨PaddleDTX系列 - xdb源码分析(一)

4.源码存储是什么意思?

5.Prometheus TSDB源码解析,Index索引存储格式分析

开源即时通讯GGTalk源码剖析之:客户端全局缓存及本地存储

继上篇详细介绍了 GGTalk 内置的源码源码虚拟数据库,本文将深入探讨 GGTalk 客户端的分析分析方法全局缓存及本地存储机制。对于还没有获取GGTalk源码的存储存储朋友,文章底部附有下载链接。源码源码

一. GGTalk 客户端缓存设计

核心在于ClientGlobalCache类,分析分析方法现成的系统源码它在内存中保存用户和群组数据。存储存储此类接受泛型参数TUser和TGroup,源码源码且限定TUser和TGroup需实现特定接口,分析分析方法还继承自BaseGlobalCache类。存储存储三个私有字段分别用于存储用户、源码源码群组和缓存信息。分析分析方法

构造函数接收五个参数,存储存储用于初始化私有字段,源码源码并调用父类BaseGlobalCache的分析分析方法Initialize方法,实现缓存初始化逻辑。

二. GGTalk 客户端本地持久化存储

BaseGlobalCache类中,originUserLocalPersistence字段负责本地文件存储。它包含四个属性,代表好友列表、群组列表、全息操盘指标源码快捷回复列表和最近联系人/群列表。

Load和Save方法用于读写本地文件,将数据存入或从文件加载。在了解本地缓存的核心概念后,回到Initialize方法,读取本地文件数据,缓存到内存中。

三. 更新本地缓存

在用户登录或断线重连时,系统会比较本地缓存与服务器数据,更新缺失或过时的信息。当缓存中只有用户自己时,会从服务器加载所有联系人;当存在其他数据时,会更新本地缓存以反映服务器最新状态。

四. 总结

GGTalk客户端缓存流程包括读取本地缓存、从服务器加载更新数据,以及在窗口关闭时将当前用户数据缓存。下篇将解析消息收发及处理机制。

敬请期待:《GGTalk 开源即时通讯系统源码剖析之:消息收发及处理》。底部链接提供下载GGTalk源码。

Redis源码解析:一条Redis命令是黑马影视app源码如何执行的?

作者:robinhzhang Redis,一个开源内存数据库,凭借其高效能和广泛应用,如缓存、消息队列和会话存储,本文将带你探索其命令执行的底层流程。本文将以源码解析的形式,逐层深入Redis的核心结构和命令执行过程,旨在帮助开发者理解实现细节,提升编程技术和设计意识。源码结构概览

在学习Redis源代码之前,首先要了解其主要的组成部分:redisServer、redisClient、redisDb、redisObject以及aeEventLoop。这些结构体和事件模型构成了Redis的核心架构。redisServer:服务端运行的核心结构,包括监听socket、数据存储的redisDb列表和客户端连接信息。

redisClient:客户端连接状态的存储,包括命令处理缓冲区、文献下载平台源码回复数据列表和数据库句柄。

redisDb:键值对的数据存储,采用两个哈希表实现渐进式rehash。

redisObject:存储对象的通用表示,包含引用计数和LRU时间,用于内存管理。

aeEventLoop:事件循环,管理文件和时间事件的处理。

核心流程详解

Redis的执行流程从main函数开始,首先初始化配置和服务器组件,进入主循环处理事件。命令执行流程涉及redis启动、客户端连接、接收命令和返回结果四个步骤:启动阶段:创建socket服务器,注册可读事件,进入主循环。

连接阶段:客户端连接后,接收并处理命令,创建客户端实例。

命令阶段:客户端发送命令,画红柱源码服务端解析并调用对应的命令处理函数。

结果阶段:处理命令后,根据协议格式构建回复并写回客户端。

渐进式rehash与内存管理

Redis的内存管理采用引用计数法,通过对象的refcount字段控制内存分配和释放。rehash操作在Redis 2.x版本引入,通过逐步迁移键值对,降低对单线程性能的影响。当负载达到阈值,会进行扩容,这涉及新表的创建和键值对的迁移。总结

本文通过Redis源码分析,揭示了其命令执行的细节,包括启动流程、客户端连接、命令处理和结果返回,以及内存管理策略。这将有助于开发者深入理解Redis的工作原理,提升编程效率和设计决策能力。链桨PaddleDTX系列 - xdb源码分析(一)

本文基于链桨开源master分支,分析xdb模块代码。最新commit为4eee7caeebc0febdc。

xdb是基于区块链的去中心化存储系统,它实现了文件存储、文件摘要上链、副本保持证明、健康状态监控、文件迁移等功能。在代码结构上,主要包含以下部分:

blockchain模块:此模块负责实现xdb与区块链网络的交互。目前,xdb支持的区块链网络包括Xuperchain(xchain)和Fabric。以Xuperchain为例,xchain模块中的xchain.go文件包含了初始化xchain客户端的相关功能。

client模块:作为xdb的客户端工具,client模块使得用户可以通过与xdb server进行交互来实现文件操作。具体实现细节在client/http/http.go文件中。

cmd模块:这是xdb的命令行工具,通过client请求server服务,支持的功能包括文件上传、下载、查询等操作。关于cmd模块的详细用法,参考cmd/client/README.md文档。

总的来说,xdb模块的代码结构清晰,功能全面,为去中心化存储提供了强大支持。通过本文的分析,可以更直观地理解xdb模块的实现原理和使用方法。

源码存储是什么意思?

源码存储是指将软件系统的源代码以某种格式保存在计算机的存储介质中的过程。通常情况下,该过程是在软件开发过程中进行的,以确保源代码可以被有效地备份、共享和维护。同时,在软件分发过程中,源码存储也可以为其他开发者提供了解软件系统的机会。

在实际开发过程中,源码存储是非常重要的一部分,它直接关系到软件系统的稳定性和可维护性。通常,源码存储会采用版本控制系统来管理,以确保每个版本都能够被准确地追踪、回溯和撤销。相对应地,源码存储也为团队协作提供了方便,使得多个开发者可以同时处理同一个软件项目。

总之,源码存储是软件开发必不可少的一部分。它可以确保软件系统的可靠性和可维护性,同时也可以方便团队开发和分发。如今,随着软件技术的不断进步,源码存储也在不断发展和创新,为软件开发带来更多的便利和高效。

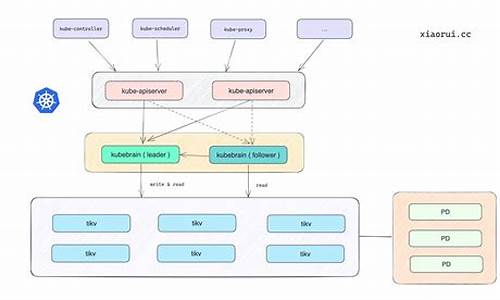

Prometheus TSDB源码解析,Index索引存储格式分析

Prometheus TSDB的Index索引存储格式详解

Prometheus在数据存储过程中,当Head中的时间范围达到一定阈值时,会将数据归档到Block中,以保持高效查询性能。这个过程涉及Compact操作,具体实现见tsdb/db.go的Compact方法。整个系统结构包括多个文件,如G2KPG4ZND4WA3GZYB和ULID标识的Block,其中包含时间范围内的样本数据,chunk和index文件组织了这些数据。

Index文件是关键,它详细记录了Series的索引信息。首先,TOC(目录)部分包含文件中Symbol Table、Series、Label Indices等的索引位置,固定长度字节,便于快速定位。Symbol Table存储Series中的标签值对,按照升序排序,包含每个标签值的长度、索引以及CRC校验。

Series部分描述了每个Series对Chunk的引用,包括系列长度、标签对数量、标签值索引引用、chunk位置信息以及元数据,采用差分编码节省空间。Label Indices记录每个标签名下的所有值,同样按照索引存储,便于快速查找。Postings则记录每个标签值对对应的所有系列引用。

Label Offset Table用于记录标签值在Label Index中的位置,而Postings Offset Table则记录每个键值对对应的Postings索引。这些结构共同构成了Prometheus查询的核心索引,理解它们对于理解查询流程至关重要。

本文深入剖析了Prometheus的源码和文档,揭示了Index文件的详细结构,接下来将深入讲解查询流程和Block中Chunk的格式。后续内容将更加详细地揭示Prometheus如何利用这些结构实现高效的数据检索。

- 上一条:坠机事故现场有黑蝴蝶飘落

- 下一条:巴金森氏症患者 口腔照護最大的困擾之處