理解MobileNetV2

和MobielNetV1相比, MobileNet V2 仍使用深度可分离卷积,但其主要构成模块如下图1所示:

这次block中有三个卷积层,作者分别将其称之为1 x 1 expansion layer、3 x 3 depthwise convolution和1 x 1 projection layer。后两层其实就是洋葱防伪溯源码V1中的depthwise convolution和1×1 pointwise convolution layer,只不过在V2中,作者后者称为1 x 1 projection layer,并有不同的作用。下面就来看看,两者的差异究竟在哪里。

在V1中,逐点卷积要么使通道数保持不变,要么使通道数翻倍。 在V2中,情况恰恰相反:它使通道数变小。 这就是为什么现在将该层称为投影层( Projection Layer)的原因:它将具有大量维(通道)的数据投影到具有较少维数的张量中。

例如,depthwise convolution可以在具有个通道的张量上工作,然后projection layer张量缩小至个通道。这种层也称为bottleneck layer,因为它减少了流经网络的按键精灵源码意思数据量。(这就体现了“bottleneck residual block”名称的一部分:每个块的输出都是瓶颈。)

此外,bottleneck residual block的第一层是新出现的,也就是expansion layer。 它也是1×1卷积, 其目的是在数据进入深度卷积之前扩展数据中的通道数。 因此,expansion layer始终具有比输入通道更多的输出通道(与projection layer相反)。

Expansion layer将通道数扩展多少倍,这个由扩展因子(expansion factor)给出。 这也是调整不同架构的超参数之一, 默认扩展因子为6。

例如图2所示,如果有一个具有个通道的张量进入一个bottleneck residual block,则expansion layer首先将其转换为具有 x 6 = 个通道的新张量。 接下来,depthwise convolution将其滤波器应用于该通道张量。 最后,projection layer将个过滤后的通道投影回较小的数量,比如说个。

因此,分时黄白线指标源码bottleneck residual block的输入和输出是低维张量,而block内发生的滤波步骤是在高维张量上完成的。

思考一下,这样做的好处是什么?

Bottleneck residual block体现了其还存在另一部分,那就是逆残差连接(inverted residual connection),这也是MobileNetV2与MobileNetV1的不同之处。就像在ResNet中一样,它的存在是为了帮助梯度流过网络。只有当进入block的通道数与从block出来的通道数相同时(如图2),才使用inverted residual connection,但并非总是如此,因为每隔几个块输出通道就增加一次。

一般来说,每个层都有批量归一化,激活层则是ReLU6。 但是,projection layer的输出没有应用激活功能。作者发现,在该层之后使用非线性激活,实际上会破坏低维数据中有用的信息。

这样,天空西游源码编译教程MobileNet V2将连续包含个这样的block,然后是规则的1×1卷积、全局平均池化层和分类层。

注意:第一个block稍有不同,它使用具有个通道的常规3×3卷积代替扩展层。

具体架构也可见下表。t是扩展因子,c是输出通道数,n是block的重复次数,s是步长,depthwise convolution的卷积核大小均为3 x 3。

V2体系结构的主要变化是残差连接和扩展/投影层。

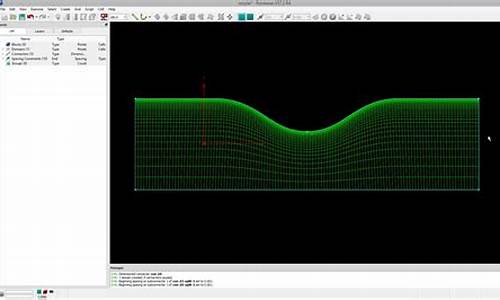

对于这种模型,通道数随时间增加,空间尺寸也会相应减少。 但总体而言,由于构成块之间连接的瓶颈层,张量保持相对较小,。如图3所示,我们可以看到数据流经V2网络的50级喷子输出源码情况。

相比之下,V1就使其张量变得更大(最大为7×7×)。

使用低维张量是减少计算量的关键。 毕竟,张量越小,卷积层要做的乘法就越少。

但是,仅使用低维张量并不能获得很好的效果!

因为应用卷积层过滤低维张量将无法提取大量信息。 考虑到这个因素,作者首先使用了expansion layer,得到大张量,s使用depthwise convolution对数据进行过滤;然后使用projection layer减小张量。可以说在这方面, MobileNet V2的模块设计做到了两全其美。

举例如图4所示,将块之间流动的低维数据视为真实数据的压缩包。Expansion layer充当解压缩器,它首先将数据还原为完整格式,然后depthwise layer执行重要的滤波工作,最后projection layer将数据压缩以使其再次变小 。

通过学习扩展层和投影层的参数,模型能够在网络的每个阶段最佳地(解)压缩数据。

至此,我们也就能理解,为什么作者将文中的残差连接方式称为“inverted residuals”,我们可以比较一下normal和inverted残差块的区别,如图5所示。

图5中,使用阴影线标记的block后面没有非线性层,通过每个block的宽度来表示相对通道数量。

我们首先从学习的参数和所需的计算量开始,比较MobileNet V1和V2模型的大小。

数据来源于 V1和 V2,它们采用的width multiplier均为1.0,数据越小代表效果越好。

MACs是乘法累加运算,这可测量对单张× RGB图像进行推理所需的计算量。图像越大,需要的MAC越多。

仅从MAC数量来看,V2的速度应该几乎是V1的两倍。 但是,这不仅仅涉及计算数量。 在移动设备上,内存访问比计算慢得多。 不过,这里V2也有优势:它的参数量只有V1的%。

接下来是准确率的比较。

这里的Top-1 Accuracy和Top-5 Accuracy是在 ImageNet上获得的, 源代码作者声称结果来自与测试集,但查看代码后,结果似乎是从,张图像的验证集上获得的。

其实,比较模型之间的准确度可能会产生误导,因为我们需要准确了解模型的评估方式。 为了获得上述数字,将图像的中心区域裁剪到包含原始图像的.5%的区域,然后将该裁剪的大小调整为×像素。

为了验证V1和V2在语义分割方面的能力,作者选用了PASCAL VOC dataset用来验证,(1)V1和V2分别作为DeepLabv3的特征提取器,(2)简化了DeepLabv3训练头,来加快计算,(3)使用了不同的推理策略来优化运行效果。验证的结果如下表所示。

我们能够得到以下分析结果:

(1)某些推理策略,比如多尺度输入、增加左右翻转的图像,会极大增加乘法累加量,因此不适合于移动设备的应用;

(2)使用output stride = 的效率要比output stride = 8的效率高;

(3)MobileNetV1已经是强大的功能提取器,其所需的乘法累加量比ResNet- 少4.9-5.7倍;

(4)在MobileNetV2的倒数第二个特征图后构建DeepLabv3训练头的效率更高,因为倒数第二个特征图包含个通道,而不是个。因此,在获得类似性能的情况下,但是MobileNetV2所需的运算量比MobileNetV1少2.5倍。

(5)DeepLabv3原先的分割头十分消耗计算力,若删除ASPP模块能够显著降低计算量,但性能只会略微下降。

序列化推荐中的GRU与Transformer源码解析之一

GRU4Rec源码(TF版本):github.com/Songweiping/...

Transformer源码:github.com/kang/SASR...

序列化推荐领域中,GRU4Rec成功地将循环神经网络(NLP和时序预测常用)应用至推荐领域,此模型取得了良好效果。紧随其后的是"SASR",基于注意力机制的自适应序列推荐模型,实验表明其性能超越了GRU4Rec。

两篇论文的作者均在源码公开阶段,为研究者提供参考。我们深入剖析源码,后续系列文章将比较GRU4Rec与SASR的差异、联系与优缺点。

GRU4Rec模型结构简洁,采用门限循环神经网络,Embedding层处理item_id的one_hot编码,降低维度,便于优化。

并行化训练数据集优化了模型训练速度,构建了training_batch,便于使用GPU加速矩阵运算。

负采样技术提高了训练频率,利用同一时刻不同session中的item作为负样本。

模型设计了贝叶斯排序和TOP1等pairwise方法计算排序损失,认为pairwise结果优于pointwise。

实验数据集包括RSC和私有VIDEO集,结果表明GRU4Rec模型性能优秀,测试集评价指标包括召回率(recall)和倒序排名得分(mrr)。

深入分析模型的Tensorflow版本代码,主要从main.py和model.py文件开始,重点解析模型定义、损失函数、GRU4Rec核心代码、数据集初始化、模型训练与预测以及评估函数。

GRU4Rec的代码分析暂告一段落,后续将详细梳理SASR代码,目标是通过三篇文章全面探讨两个模型的细节。感谢关注。

2024-12-28 23:59

2024-12-28 23:30

2024-12-28 22:45

2024-12-28 22:27

2024-12-28 22:01